रोबोटिक हथियार-एक नैतिक दुविधा

बुध, 27 अक्टूबर 2021 | 7 मिनट में पढ़ें

लीबिया के गृहयुद्ध से संबंधित संयुक्त राष्ट्र सुरक्षा परिषद की हालिया रिपोर्ट के अनुसार, स्वायत्त हथियार प्रणाली (ऑटोनोमस वीपन सिस्टम) जिसे आम तौर पर किलर रोबोट के रूप में जाना जाता है, ने पहली बार इंसानों की हत्या पिछले साल की हो सकती है। इतिहास में इसे आने वाले प्रमुख हथियारों की दौड़ की शुरुआत के रूप में जाना जा सकता है, जिसमें मानवता को समाप्त करने की क्षमता है।

अमेरिका स्थित सैन्य रोबोट निर्माता घोस्ट रोबोटिक्स ने स्वायत्त हथियार की दिशा में नवीनतम कदम उठाते हुए एक रोबोट कुत्ते को एक स्नाइपर राइफल थमा दी। हमारे सबसे वफादार दोस्त की छवि वाले कुत्ते में एक हत्यारा रोबोट बनाने की संभावना पर कुछ लोगों ने नैतिक आक्रोश जताते हुए प्रतिक्रिया भी व्यक्त की है। लेकिन अगर हम इस विकास पर उठने वाले विचारों को दरकिनार कर दें, तो मौजूदा रोबोट हथियार एक उपयोगी उद्देश्य को पूरा कर सकता है। घोस्ट रोबोटिक्स की नवीनतम रचना पर प्रतिक्रिया से उस घटना की स्मृति होती है जिसमें बोस्टन डायनेमिक्स (कुत्ते के समान रोबोट का निर्माण करने वाली अन्य कंपनी) को ऐसी प्रतिक्रिया के विपरीत हथियार बनाने के विचार पर और दृढ़ कर देते हैं।

तस्वीर स्रोत : newscientist.com

स्वायत्त हथियार प्रणाली घातक हथियारों वाले रोबोट हैं जो स्वतंत्र रूप से काम कर सकते हैं। मानवीय मूल्यों पर विचार किये बिना लक्ष्य का चयन और हमला कर सकते हैं। दुनिया भर की सेनाएं स्वायत्त हथियारों के अनुसंधान और विकास में भारी निवेश कर रही हैं। अकेले अमेरिका ने 2016 और 2020 के बीच स्वायत्त हथियारों के लिए 18 बिलियन अमेरिकी डॉलर का बजट रखा।

स्वायत्त हथियार

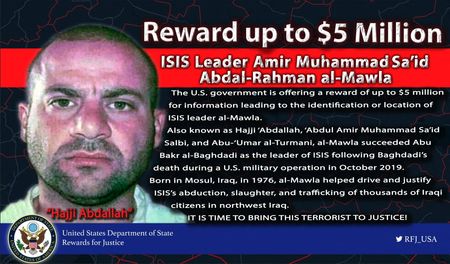

स्वायत्त हथियार प्रणाली सेना या युद्ध के लिए बिल्कुल नई नहीं हैं। पिछले दशक में मानव रहित हवाई वाहनों (यूएवी) या ड्रोन का विकास बहुत तेजी से हुआ है और इन्हें विभिन्न सेना अभियानों में उपयोग भी किया गया है। अफगानिस्तान या इराक में यूएवी के उपयोग से आतंकवादियों को निष्प्रभावी किये जाने की छवियां तो आम हो गईं हैं। हालांकि आतंकवादी ग्रुपों द्वारा ड्रोन समूहों के जरिये सऊदी अरब के ऑयलफील्डों पर हालिया हमलों ने दुनिया भर के नेताओं का ध्यान उभरते खतरों की ओर आकृष्ट किया है। यूएवी और ड्रोन मानव नियंत्रण/कमांड या प्री-फेड मिशन प्रोफाइल पर काम करते हैं। आर्टिफिशियल इंटेलिजेंस (एआई)/मशीन लैंग्वेज (एमएल) के विकास के कारण होने वाले व्यवधानों ने इन्हें स्वायत्त बनाने की संभावना की ओर उन्मुख किया। यूएवी की तर्ज पर, मानव रहित ग्राउंड व्हीकल्स (यूजीवी) का भी युद्ध के साथ-साथ युद्ध के मैदानों में लॉजिस्टिक के लिए प्रमुखता से उपयोग किया जा रहा है। एआई मॉड्यूल के साथ लगी बंदूकें और सेंसर के साथ ये प्लेटफॉर्म उन्हें स्वायत्त और प्रस्तुत परिदृश्यों के अनुसार निर्णय लेने में सक्षम बनाते हैं।

मानवाधिकारों के संदर्भ में स्वायत्त हथियार दुविधा क्यों पैदा करते हैं?

मानवाधिकार और मानवीय संगठन ऐसे हथियारों के विकास पर नियम और निषेध स्थापित करने के लिए भरपूर प्रयास कर रहे हैं। विदेश नीति के विशेषज्ञ चेतावनी देते हैं कि विघटनकारी स्वायत्त हथियार प्रौद्योगिकियां बिना किसी नियंत्रण के, वर्तमान परमाणु रणनीतियों को खतरनाक रूप से अस्थिर कर देंगी, क्योंकि वे रणनीतिक प्रभुत्व की धारणाओं को बदल सकती हैं। वे रासायनिक, जैविक, रेडियोलॉजिकल और परमाणु हथियारों से लैस होकर हमलों के जोखिम को बढ़ा सकती हैं।

रोबोटिक या स्वायत्त हथियार प्रणाली से जुड़ी मुख्य समस्याओं को संक्षेप में निम्नवत प्रस्तुत किया जा सकता है:

- गलत पहचान की समस्या:लक्ष्य का चयन करते समय, क्या स्वायत्त हथियार शत्रु सैनिकों और टॉय गन से खेलने वाले 12 साल के बच्चों के बीच अंतर करने में सक्षम होंगे? संघर्ष स्थल से भागने वाले नागरिकों और एक सामरिक युद्ध से वापसी करने वाले विद्रोहियों के बीच फर्क कर सकेंगे? यहाँ समस्या यह नहीं है कि ये मशीनें ऐसी गलतियाँ करेंगी और मनुष्य नहीं करेंगे। पूरे महाद्वीप में तैनात एक लक्ष्यीकरण एलगारिथ्म द्वारा निर्धारित हत्यारे रोबोट सिस्टम का पैमाना, दायरा और गति समस्या हो सकती है। मनुष्यों द्वारा गलत पहचान का उदाहरण अफगानिस्तान में हाल ही में अमेरिकी ड्रोन हमले के दौरान देखा गया। इसकी तुलना में स्वायत्त हथियारों की त्रुटियों से बड़े पैमाने पर विनाश हो सकता है। जब एआई सिस्टम गलती करते हैं, तो वे थोक में गलती करते हैं। जब वे गलती करते हैं, तो उनके निर्माता भी अक्सर नहीं जानते कि उन्होंने ऐसा क्यों किया और उन्हें कैसे ठीक किया जाए।

- कम मात्रा में प्रसार:स्वायत्त हथियार विकसित करने वाली सेनाएं इस धारणा पर आगे बढ़ रही हैं कि वे स्वायत्त हथियारों के उपयोग को रोकने और नियंत्रित करने में सक्षम होंगी। लेकिन अगर हथियार प्रौद्योगिकी के इतिहास ने दुनिया को कुछ सिखाया है, तो वह यह है, हथियारों का प्रसार। बाजार के दबाव के परिणामस्वरूप उनका व्यापक पैमाने पर निर्माण और बिक्री हो सकती है। कलाश्निकोव असॉल्ट राइफल के समान हत्यारे रोबोट जो सस्ते, प्रभावी और रोकने में लगभग असंभव हैं क्योंकि वे दुनिया भर में फैल सकते हैं।”कलाश्निकोव” स्वायत्त हथियार, अंतरराष्ट्रीय और घरेलू आतंकवादियों सहित सरकारी नियंत्रण से बाहर के लोगों के हाथों में आ सकते हैं।

- भारी मात्रा में प्रसार:स्वायत्त हथियारों के तीव्र विनाशकारी संस्करणों को विकसित करने के लिए विभिन्न देश प्रतिस्पर्धा कर सकते हैं। वे रासायनिक, जैविक, रेडियोलॉजिकल और परमाणु हथियारों को ले जाने में सक्षम हो सकते हैं। हथियारों की घातकता बढ़ने से नैतिक खतरे भी बढ़ेंगे क्योंकि हथियारों का उपयोग बढ़ेगा। भारी मात्रा में स्वायत्त हथियारों के प्रसार से अधिक युद्ध होने की संभावना है क्योंकि वे सैन्य बलों को कम कर देंगे। सेनिकों की संख्या के कारण ही इतिहास में युद्ध कम कमय के लिए हुए या कम हुए। विदेशों में रहने वाले नागरिकों और अपने स्वयं के सैनिकों की चिंता के कारण युद्ध पर नियंत्रण रहता था। स्वायत्त हथियार अपने स्वयं के सैनिकों की आवश्यकता और जोखिम दोनों को कम कर देंगे। देशों को युद्ध शुरू करने और उसको बरकरार रखने के लिए लागत-लाभ विश्लेषण में भी नाटकीय रूप से कमी आयेगी।

- सशस्त्र संघर्ष के कानून (LOAC): स्वायत्त हथियार युद्ध अपराधों और अत्याचारों के खिलाफ मानवीय विकल्प एलओएसी को कमजोर कर देंगे। ये कानून, 1864के जेनेवा कन्वेंशन की संधियों में संहिताबद्ध हैं, जो युद्ध को और नरसंहार को सम्मान सहित अलग करनेवाली अंतरराष्ट्रीय रेखा की तरह है। वे इस विचार पर आधारित हैं कि युद्ध के दौरान भी लोगों को उनके कार्यों के लिए जवाबदेह ठहराया जा सकता है, युद्ध अन्य सैनिकों को मारने के अधिकार की तरह नागरिकों की हत्या का अधिकार नहीं देता। लेकिन स्वायत्त हथियारों को कैसे जवाबदेह ठहराया जा सकता है? युद्ध अपराध करने वाले रोबोट के लिए कौन दोषी होगा? किस पर मुकदमा चलाया जाएगा? हथियार पर, सैनिक पर, सैनिकों के कमांडर पर या उस कॉर्पोरेशन पर जिसने हथियार बनाया है? गैर-सरकारी संगठनों और अंतरराष्ट्रीय कानून के विशेषज्ञों को चिंता है कि स्वायत्त हथियारों से जवाबदेही में गंभीर रूप से कमी आएगी।

एआई – दोधारी तलवार

आर्टिफिशियल इंटेलिजेंस कंप्यूटर विज्ञान की वह शाखा है जो कंप्यूटर को इंसानों की तरह व्यवहार करने से संबंधित है। संयुक्त राष्ट्र की एक हालिया रिपोर्ट के अनुसार, लीबिया के सरकारी बलों ने “घातक स्वायत्त हथियार प्रणालियों” का उपयोग करके विद्रोही ताकतों का शिकार किया। ये ऐसे उपकरण थे जिन्हें “ऑपरेटर और हथियार के बीच डेटा कनेक्टिविटी की आवश्यकता के बिना लक्ष्य पर हमला करने के लिए प्रोग्राम किया गया था”। घातक ड्रोन डिनर प्लेट के आकार के तुर्की-निर्मित क्वाडकॉप्टर थे, जो एक किलोग्राम या उससे अधिक वजन के वारहेड पहुंचाने में सक्षम थे।

आर्टिफिशियल इंटेलिजेंस के शोधकर्ता ऐसे घातक स्वायत्त हथियार प्रणालियों के बारे में चेतावनी देते रहे हैं, जो वर्षों से मानव हस्तक्षेप के बिना जीवन या मृत्यु के बारे में निर्णय ले सकते हैं। परमाणु बम के पहले परीक्षण से ठीक पहले, मैनहट्टन परियोजना पर काम कर रहे कई वैज्ञानिक परमाणु हथियारों के भविष्य के बारे में चिंतित थे। जुलाई 1945 में राष्ट्रपति हैरी एस. ट्रूमैन को एक गुप्त याचिका भेजी गई थी। इसमें भविष्य के परिदृश्य की सटीक भविष्यवाणी की गयी थी। इस बार आर्टिफिशियल इंटेलिजेंस से और विशेष रूप से घातक स्वायत्त हथियारों के विकास से खतरा है। ऐसे हथियार जो मानव हस्तक्षेप के बिना लक्ष्यों को पहचान सकते हैं, ट्रैक कर उसे नष्ट कर सकते हैं। मीडिया में उन्हें “हत्यारा रोबोट” कहा जाता है।

एआई के नियमों के निर्धारण में प्रौद्योगिकी के नुकसान और लाभ पर विचार करना चाहिए। वंचित समुदायों के साथ भेदभाव की क्षमता और स्वायत्त हथियारों के अनियंत्रित विकास को ध्यान में रखते हुए नियम और कानून बनाये जाने चाहिए। संवेदनशील एआई विनियमन इसके लाभों को अधिकतम करेगा और होनेवाले नुकसान को कम करेगा।

भविष्य

यदि कोई बड़ी सैन्य शक्ति एआई हथियार विकास के साथ आगे बढ़ती है, तो वैश्विक हथियारों की होड़ लगभग अपरिहार्य है। इस तरह के एक तकनीकी ट्रेजेक्टरी का परिणाम स्पष्ट है, स्वायत्त हथियार आने वाले समय के कलाश्निकोव बन जाएंगे।

रणनीतिक रूप से, स्वायत्त हथियार सेना के लिए एक सपना है। ऐसा सपना जो सेना को जवानों की कमी के बावजूद युद्ध संचालन की क्षमता प्रदान करता है। एक प्रोग्रामर सैकड़ों स्वायत्त हथियारों को कमांड कर सकता है। सेना अपने स्वयं के सैनिकों को खतरे में डाले बिना अत्यधिक जोखिम भरा मिशन पूरा कर सकती है। नैतिक तर्कों से परे, हत्यारे रोबोटों के बारे में चिंतित होने के कई तकनीकी और कानूनी कारण भी हैं। सबसे मजबूत कारण यह है कि वे युद्ध में विस्फोटक क्रांति लाएंगे। स्वायत्त हथियार भारी विनाशकारी हथियार होंगे। पहले, देशों को युद्ध छेड़ने के लिए जवानों की एक सेना रखनी पड़ती थी। एक सेना को आदेशों का पालन करने, प्रशिक्षित करने, भुगतान करने, खिलाने और बनाए रखने के लिए उनको खुश रखने की आवश्यकता होती है। अब केवल एक प्रोग्रामर ही सैकड़ों हथियारों को नियंत्रित कर सकता है।

असमान युद्ध – प्रतिस्पर्धात्मक रूप से तकनीकी कमी वाले राष्ट्रों की धरती पर छेड़े गए युद्ध- अधिक होने की संभावना है। दुनिया भर में शीत युद्ध के दौरान सोवियत और अमेरिकी सैन्य हस्तक्षेपों के कारण वैश्विक अस्थिरता से लेकर वर्तमान छद्म युद्ध तक जो अनुभव किए गये हैं उसके अनुसार हर देश उच्च श्रेणी के स्वायत्त हथियारों को हासिल करने का प्रयास करेगा।

इस मुद्दे पर दुनिया एक ऐसे चौराहे पर खड़ी है, जिसमें कौन रहता है-कौन मरता है, का निर्णय मशीनों द्वारा किया जायेगा। इसे नैतिक रूप से स्वीकार नहीं किया जा सकता। संयुक्त राष्ट्र में राजनयिकों को उनके उपयोग को सीमित करने वाली एक ऐसी संधि पर विचार करना होगा, जिस तरह हमारे पास संभावित विनाशकारी स्थितियों को रोकने के लिए रासायनिक, जैविक और अन्य हथियारों को सीमित करने की संधियाँ हैं। “एआई वर्चस्व” हासिल करने के लिए चीन और रूस के साथ अमेरिका में मची तकनीकी होड़ के बीच नियमों का निर्धारण पिछड़ गया है।

निष्कर्ष

ऐसे युग में जहां हथियार प्रौद्योगिकी का विकास ख़तरनाक गति से हो रहा है। इस तरह की कोई भी तकनीकी बढ़त युद्ध में/सौदेबाजी की मेज पर किसी भी राष्ट्र की सफलता की संभावनाओं को तेजी से बढ़ा सकती है। ऐसे में रोबोटिक हथियारों के आगमन से युद्ध में संघर्ष की क्षमता में व्यापक बदलाव आयेगा। साथ ही यह हमारे लिए चेतावनी भी जारी करता है कि, हमें इस तरह की विघटनकारी तकनीक को ‘दुष्ट राष्ट्रों या गैर-जिम्मेदार तत्वों के हाथों में नहीं पड़ने देना चाहिए, ताकि ऐसी तकनीक किसी भी मायने में आर्मगेडन साबित न हो।

(यह लेख रॉयटर्स कनेक्ट पर टीम चाणक्य फोरम द्वारा किये गये विभिन्न वार्तालापों का संकलन है)

ग्रन्थसूची : रायटर कनेक्ट के माध्यम से बातचीत

- reuters.com,2021:newsml_CNVRST000LH2RAX:438693260

- reuters.com,2021:newsml_CNVRST000LGO12Q:968169975

- reuters.com,2021:newsml_CNVRST000LGM9ZS:343714239

***********************************

अस्वीकरण

इस लेख में व्यक्त विचार लेखक के निजी हैं और चाणक्य फोरम के विचारों को नहीं दर्शाते हैं। इस लेख में दी गई सभी जानकारी के लिए केवल लेखक जिम्मेदार हैं, जिसमें समयबद्धता, पूर्णता, सटीकता, उपयुक्तता या उसमें संदर्भित जानकारी की वैधता शामिल है। www.chanakyaforum.com इसके लिए कोई जिम्मेदारी नहीं लेता है।

चाणक्य फोरम आपके लिए प्रस्तुत है। हमारे चैनल से जुड़ने के लिए यहां क्लिक करें (@ChanakyaForum) और नई सूचनाओं और लेखों से अपडेट रहें।

जरूरी

हम आपको दुनिया भर से बेहतरीन लेख और अपडेट मुहैया कराने के लिए चौबीस घंटे काम करते हैं। आप निर्बाध पढ़ सकें, यह सुनिश्चित करने के लिए पूरी टीम अथक प्रयास करती है। लेकिन इन सब पर पैसा खर्च होता है। कृपया हमारा समर्थन करें ताकि हम वही करते रहें जो हम सबसे अच्छा करते हैं। पढ़ने का आनंद लें

सहयोग करें

POST COMMENTS (0)